当地时间4月12日,微软宣布开源DeepSpeed-Chat,帮助用户轻松训练类ChatGPT等大语言模型,人人都有望拥有专属ChatGPT。

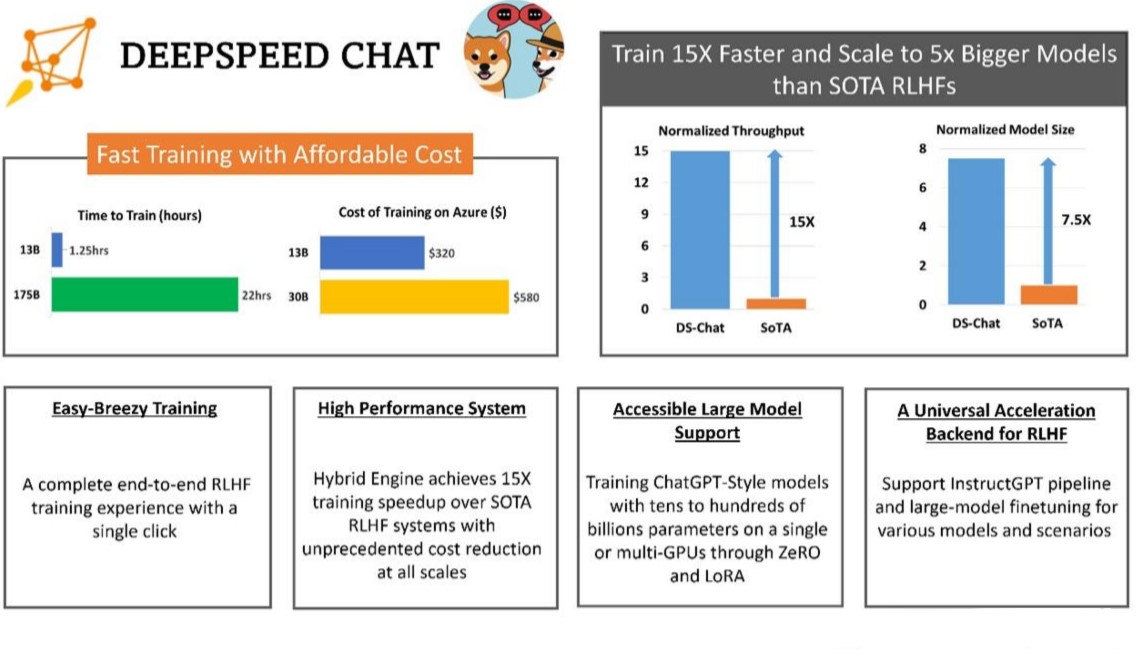

据悉,Deep Speed Chat基于微软Deep Speed深度学习优化库开发,具备训练、强化推理等功能,使用RLHF技术,可将训练速度提升15倍以上,并大幅降低成本。

OpenAI之前明确表示拒绝开源GPT-4,也收获了无数“OpenAI并不open”的吐槽。

而AI开源社区已推出LLaMa、Vicuna、Alpaca等多个模型,帮助开发者开发类ChatGPT模型。

即便如此,现有解决方案下训练数千亿参数的最先进类ChatGPT模型依旧困难,主要瓶颈便在于缺乏RLHF训练普及。

而微软本次开源的DeepSpeed-Chat,便补齐了最后这一块“短板”,帮助在模型训练中加入完整RLHF流程的系统框架。

仅需一个脚本,便可以完成RLHF训练的全部三个阶段,类ChatGPT大语言模型生成唾手可得,堪称“傻瓜式操作”。

更亮的是,DeepSpeed Chat把成本大大地打了下来。

此前,昂贵的多GPU设置超出了许多研究者的能力范围,并且,即使能访问多GPU集群,现有的方法也无力负担数千亿参数ChatGPT模型的训练。

现在,只要花1620美元,就可以通过混合引擎DeepSpeed-HE,在2.1天内训练一个OPT-66B模型。

而如果使用多节点、多GPU系统,DeepSpeed-HE可以花320美元,在1.25小时内训练一个OPT-13B模型,花5120美元,就能在不到一天的时间内训练一个OPT-175B模型。

前Meta AI专家Elvis激动转发,称这是一件大事,并表示好奇DeepSpeed Chat和ColossalChat相比起来如何。

点击收藏本站,随时了解时事热点、娱乐咨询、游戏攻略等更多精彩文章。